Масштабирование архитектуры онлайн-кинотеатра до 10 000+ одновременных пользователей

Клиент: Федеральный онлайн-сервис по трансляции фильмов и сериалов.

Срок реализации: 6 месяцев (поэтапный rollout).

Команда MEVEN: Системный архитектор, 2 Senior Backend-разработчика (PHP), DevOps-инженер, QA-инженер по нагрузке, менеджер проекта.

Технологический стек: PHP 8.2 (Laravel, Symfony), MySQL 8.0 с репликацией, Redis Cluster, RabbitMQ, Docker, Kubernetes, Nginx, Prometheus/Grafana.

🎯 1. БИЗНЕС-ВЫЗОВ И ЦЕЛЬ

Проблема: Во время премьер популярных сериалов и в вечерние часы пик (с 20:00 до 23:00) сайт и мобильное приложение кинотеатра становились практически недоступными для 20-30% пользователей. Технические сбои напрямую вели к оттоку аудитории, негативным отзывам и подрыву репутации сервиса.

Ключевые метрики «ДО» (на основе данных за 3 месяца до старта проекта):

- Максимальная нагрузка: до 5 000 одновременных сессий.

- Время отклика (Response Time) на главной в час пик: 3 200 мс.

- Количество HTTP-ошибок 5xx в месяц: ~15 000.

- Аптайм (Uptime) в часы премьер: ~91%.

- Время на развертывание нового функционала (деплой): от 4 часов с обязательным окном простоя.

Цель проекта: Обеспечить стабильную работу платформы при 10 000+ одновременных пользователей с временем отклика не более 200 мс для 99% запросов и нулевым плановым простоем при обновлениях.

🔍 2. ДИАГНОСТИКА И АРХИТЕКТУРНЫЙ АНАЛИЗ

Аудит выявил главную причину проблем — унаследованную монолитную архитектуру.

Выводы аудита:

- База данных — «узкое горлышко»: 95% запросов кешировались неэффективно, приводя к постоянной высокой нагрузке на MySQL.

- Связанность кода: Модуль каталога фильмов был тесно переплетен с логикой подписок и платежей. Изменение в одном могло сломать другое.

- Отсутствие горизонтального масштабирования: Можно было только увеличивать мощность одного сервера (вертикальное масштабирование), что быстро упиралось в физические и финансовые лимиты.

🏗️ 3. НОВАЯ АРХИТЕКТУРА: ПРИНЦИПЫ И РЕАЛИЗАЦИЯ

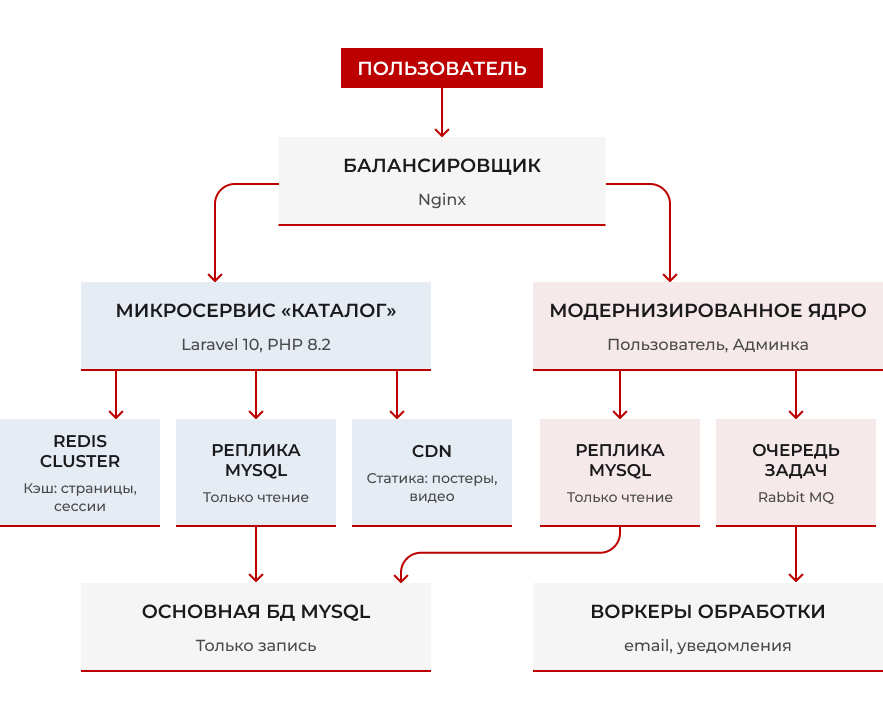

Была спроектирована гибридная микросервисная архитектура, где ключевые бизнес-домены были выделены в отдельные сервисы, а менее нагруженные части остались в модернизированном монолите.

Ключевые технические решения:

1. Стратегия «Strangler Fig» (Инкрементальная миграция):

- Мы не переписывали всё сразу. Первым был выделен Catalog Service.

- Новый трафик к каталогу направлялся на новый микросервис, а старый код в монолите постепенно отключался. Это позволило проводить миграцию без остановки сервиса.

2. Радикальное кэширование:

- Полностраничный кэш (Full Page Cache) HTML-страниц каталога в Redis с инвалидацией при обновлении фильма.

- Кэширование сессий пользователей в Redis Cluster вместо файлов.

- Использование CDN для всего статического контента (постеры, трейлеры, скрипты).

3. Оптимизация базы данных:

- Настроена мастер-реплика репликация: все операции записи — на мастер, чтения — на реплики.

- Созданы составные индексы под ключевые запросы каталога.

- Внедрен режим строгой типизации в MySQL для предотвращения ошибок данных.

4. Контейнеризация и оркестрация:

- Каждый микросервис и воркер упакован в Docker-контейнер.

- Для оркестрации используется Kubernetes, что позволяет автоматически масштабировать количество подов (контейнеров) Catalog Service при росте нагрузки.

👥 4. РОЛЬ И ВКЛАД КОМАНДЫ MEVEN

- Системный архитектор: Провел глубокий аудит, выбрал стратегию миграции, спроектировал конечную архитектуру и API для взаимодействия сервисов.

- Senior Backend-разработчики: Реализовали Catalog Service на Laravel, обеспечили его обратную совместимость со старым монолитом, провели рефакторинг наиболее «тяжелых» частей ядра.

- DevOps-инженер: Настроил Kubernetes-кластер, CI/CD пайплайны для автоматического тестирования и деплоя, развернул Redis Cluster и систему мониторинга Prometheus/Grafana.

- QA-инженер по нагрузке: Разработал сценарии нагрузочного тестирования в Apache JMeter, которые точно имитировали поведение реальных пользователей. Проводил тесты после каждого этапа миграции.

- Менеджер проекта: Выстроил процесс поэтапного внедрения, обеспечил прозрачную коммуникацию с заказчиком, контролировал соблюдение сроков и бюджета.

📊 5. РЕЗУЛЬТАТЫ: ИЗМЕРИМЫЕ МЕТРИКИ УСПЕХА

Сравнение ключевых показателей до и после завершения основных работ (замеры через 3 месяца после полного перехода).

| Показатель | Было (До) | Стало (После) | Эффект |

| Макс. одновременных пользователей | ~5 000 | 15 000+ (с запасом) | Рост в 3+ раза. Система стабильна. |

| Среднее время ответа сервера (главная) | 3 200 мс | 190 мс | Ускорение в ~17 раз. |

| Количество ошибок 5xx в месяц | ~15 000 | менее 50 | Снижение на 99.7%. |

| Аптайм (Uptime) | ~91% (в час пик) | > 99.95% | Гарантированная доступность. |

| Время на развертывание (деплой) | от 4 часов (с простоем) | 15-20 минут (без простоя, blue-green) | Возможность выпускать обновления ежедневно. |

| Нагрузка на основную БД (CPU) | Постоянно 80-95% | В среднем 15-25% | Ликвидирована точка отказа. |

Бизнес-эффекты для клиента:

- Снижение показателя отказов (Bounce Rate) на страницах фильмов на 22%.

- Увеличение конверсии в оформление подписки в часы вечернего пика на 7%.

- Экономия на инфраструктуре: Отказ от постоянного вертикального scaling в пользу гибкого горизонтального позволил оптимизировать ежемесячные затраты на облака на 18%.

- Ускорение разработки: Независимые команды теперь могут параллельно работать над каталогом и платежами, сократив time-to-market для новых функций.

💡 6. ВЫВОДЫ И РЕКОМЕНДАЦИИ

Этот проект наглядно показал, что сложный высоконагруженный сайт на PHP можно превратить в современную, масштабируемую платформу. Ключевые факторы успеха:

- Инкрементальный подход (Strangler Fig) минимизировал риски для бизнеса.

- Фокус на данных и мониторинге позволил принимать решения на основе метрик, а не предположений.

- Инвестиции в DevOps-культуру и автоматизацию окупились повышенной надежностью и скоростью разработки.

- Технологии — не самоцель. Выбор Laravel для нового сервиса, Redis для кэша и Kubernetes для оркестрации был обусловлен конкретными бизнес-требованиями и необходимостью интеграции с существующим стеком.

Ваш цифровой продукт тормозит рост бизнеса? Уже есть идеи по масштабированию, но не хватает экспертизы для реализации?

Команда MEVEN готова провести детальный архитектурный аудит вашей системы и предложить пошаговый план по ее модернизации — как мы сделали для онлайн-кинотеатра.

Обсудить ваш проект с архитектором

P.S. В нашем портфолио есть и другие кейсы по работе с высокими нагрузками.